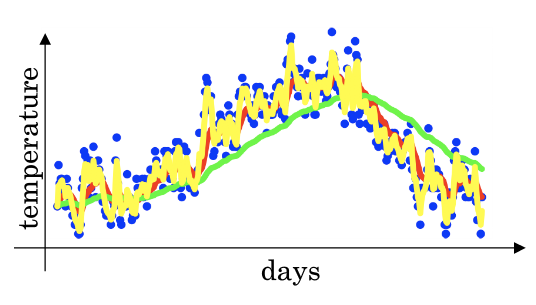

优化算法:指数加权平均

在学习吴恩达的深度学习系列课程,优化算法部分,权重更新部分讲到指数加权平均,查找到下面博文。此博文看配图,举例,也是吴恩达课程的总结,故此转载。

原作:cloud&ken

发表于:博客园

链接:https://www.cnblogs.com/cloud-ken/p/7723755.html

指数加权平均

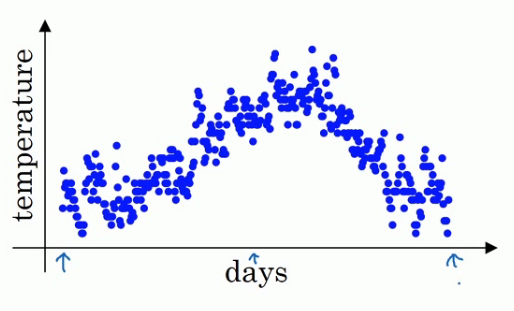

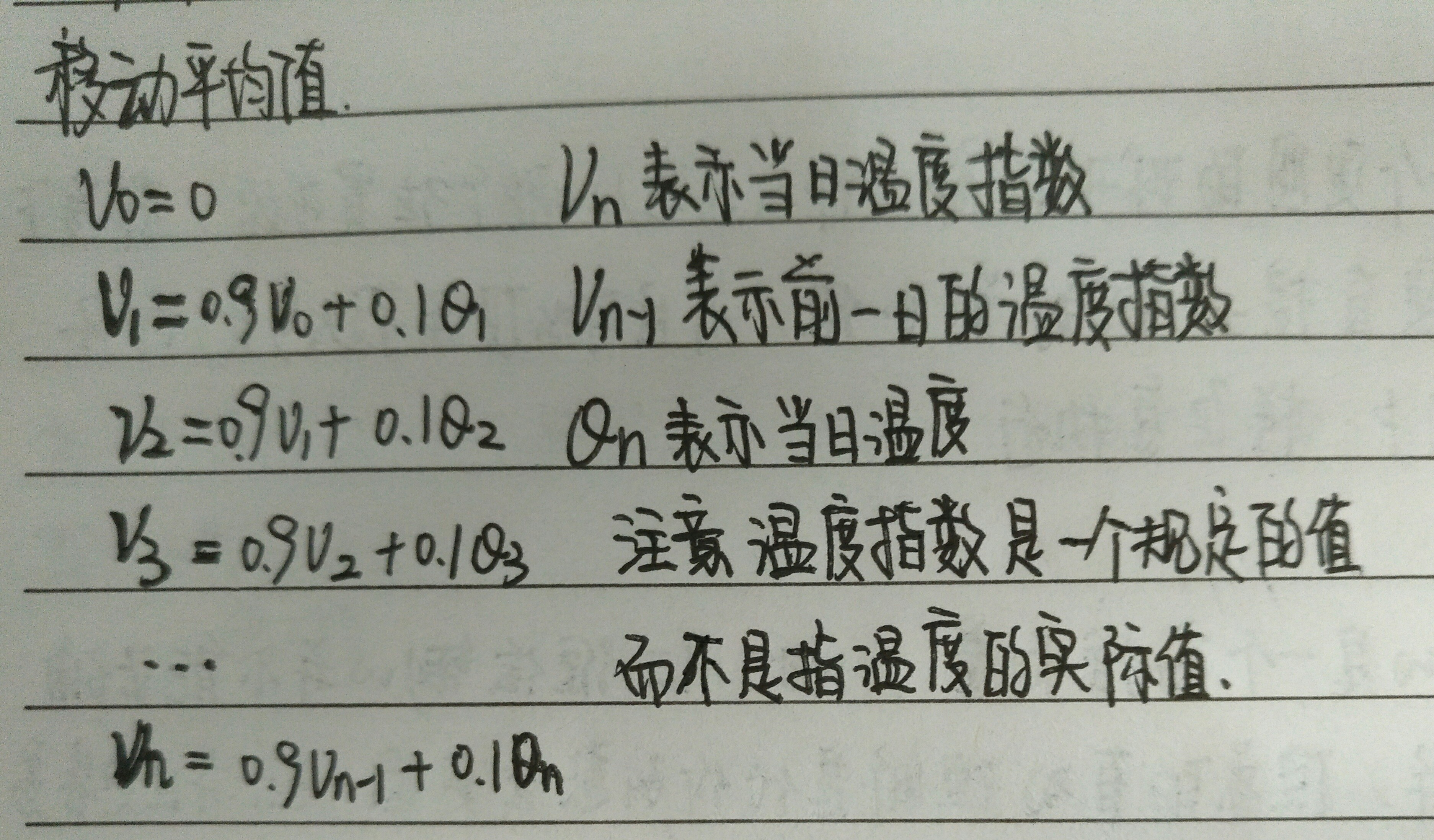

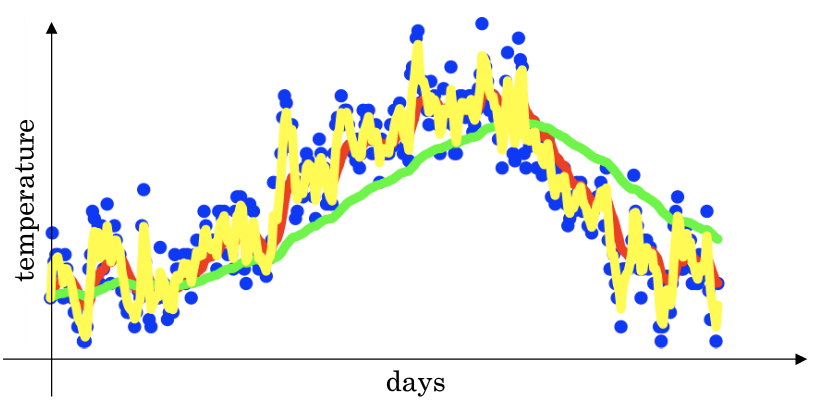

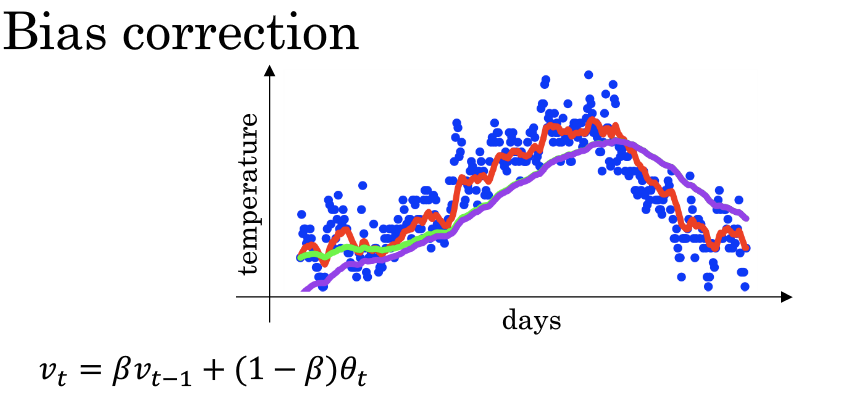

举个例子,对于图中英国的温度数据计算移动平均值或者说是移动平均值(Moving average).

大体公式就是前一日的V值加上当日温度的0.1倍,如果用红线表示这个计算数值的话就可以得到每日温度的指数加权平均值.

- 对于θ

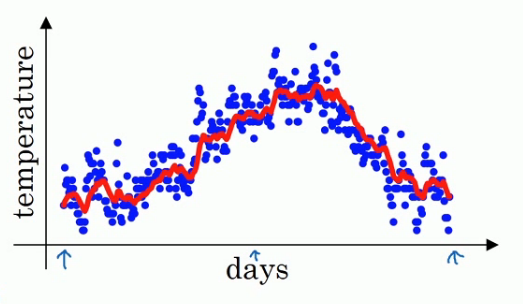

的理解,你可以将其认为该数值表示的是 11−β 天的平均值,例如如果这里取 β 是取0.9,那么这个V值表示的是十天以来的温度的加权平均值.如果我们设置 β

- 值是0.98那么我们就是在计算50天内的指数加权平均,这时我们用图中的绿线表示指数加权平均值

- 我们看到这个高值的β=0.98

得到的曲线要平坦一些,是因为你多平均了几天的温度.所以波动更小,更加平坦.缺点是曲线向右移动,这时因为现在平均的温度值更多,所以会出现一定的延迟.对于 β=0.98

- 作图运行后得到黄线,由于仅平均了两天的温度,平均的数据太少,所以得到的曲线有更多的噪声,更有可能出现异常值,但是这个曲线能更快的适应温度变化,所以指数加权平均数经常被使用.

- 在统计学中,它常被称为指数加权移动平均值

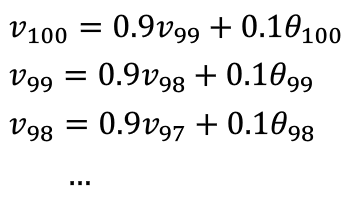

2.4 理解指数加权平均

公式:

- β

为0.9时,得到的是红线,β为0.98,得到的是绿线,β

- 为0.5时,得到的是黄线.

- 通过计算,我们发现0.910≈1e≈0.35

,也就是说对于$\beta=0.9而言10天之后权重就会下降到\frac{1}{3}$对于β=0.98而言,有0.9850≈1e≈0.35,即50天之后权重就会下降到13

即有

优势

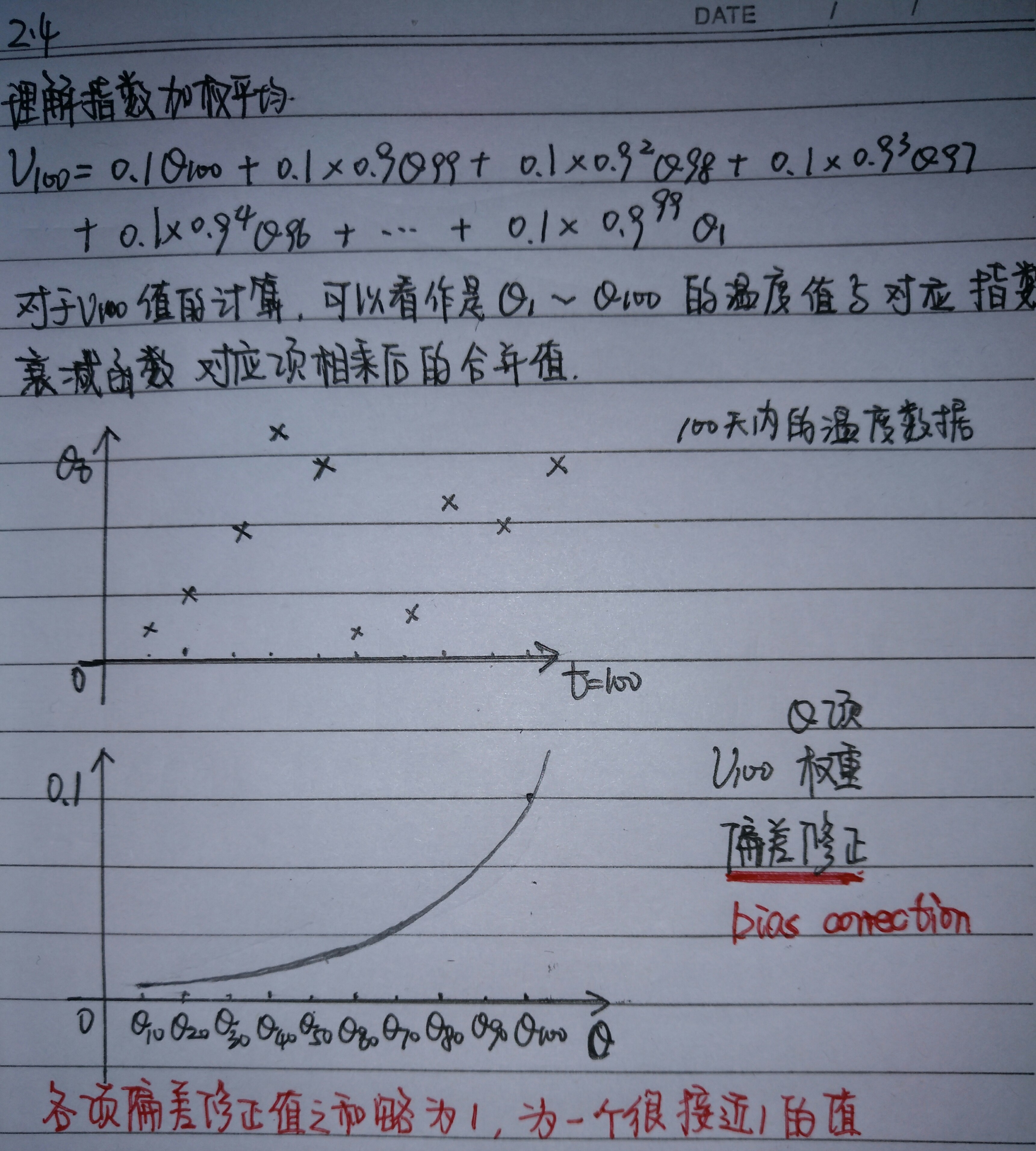

实际处理数据时,我们会使用以下公式:

- 内存代码仅仅占用一行数字而已,不断覆盖掉原有的V值即可,只占单行数字的存储和内存.虽然不是最精确的计算平均值的方法,但是相比于原有的计算平均值需要保存所有数据求和后取平均的方法效率更高和资源占用率大大减小.所以在机器学习中大部分采用指数加权平均的方法计算平均值.

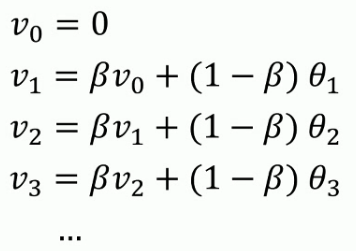

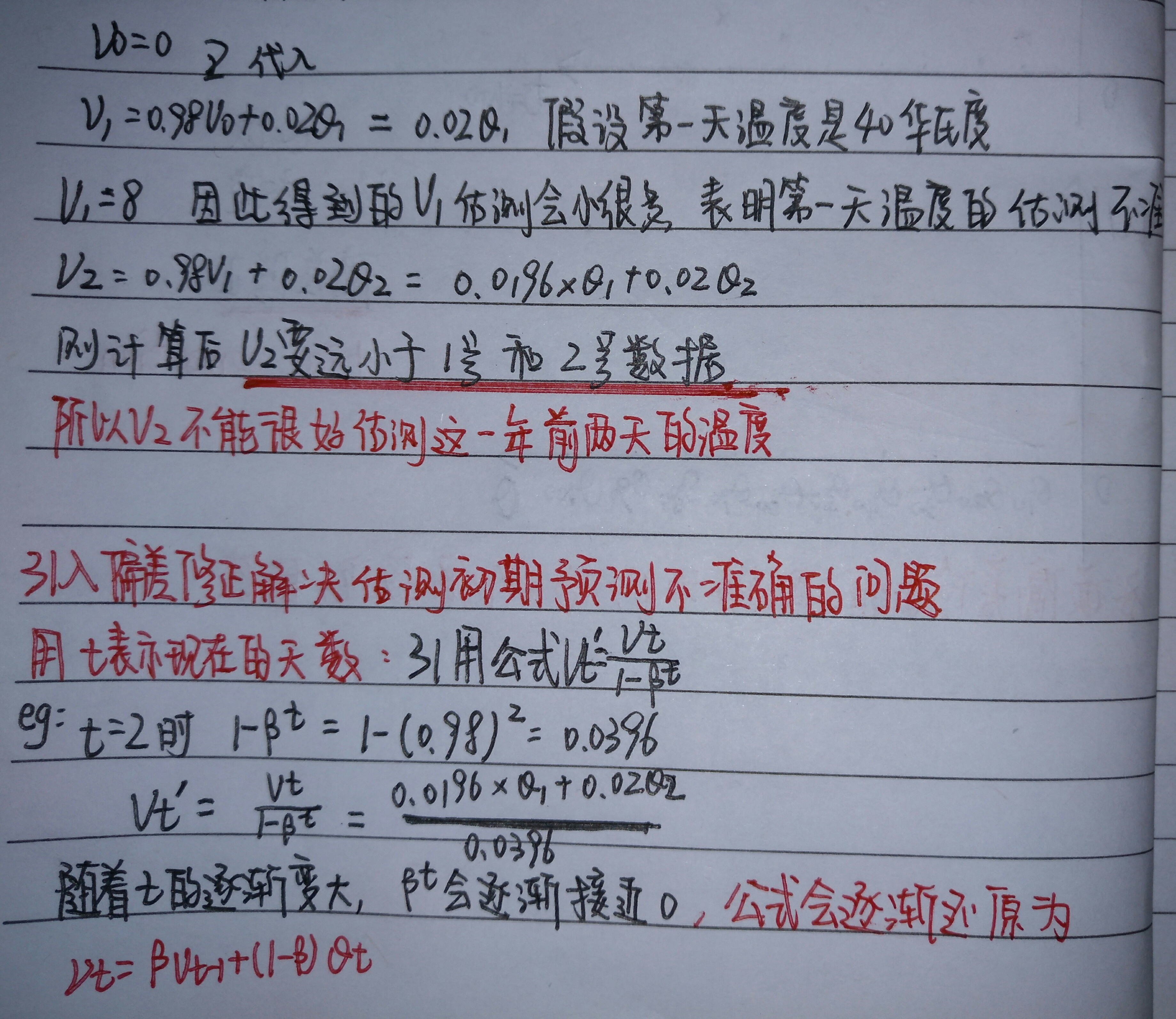

2.5 指数加权平均的偏差修正

当我们取β=0.98

时,实际上我们得到的不是绿色曲线,而是紫色曲线,因为使用指数加权平均的方法在前期会有很大的偏差,为此我们引入了偏差修正的概念

指数加权平均公式:

带修正偏差的指数加权平均公式:

补充

在机器学习中,在计算指数加权平均数的大部分时候,大家不太在乎偏差修正,大部分宁愿熬过初始阶段,拿到具有偏差的估测,然后继续计算下去.

如果你关心初始时期的偏差,修正偏差能帮助你在早期获得更好的估测

优化算法:指数加权平均相关推荐

- 为什么在优化算法中使用指数加权平均

本文知识点: 什么是指数加权平均? 为什么在优化算法中使用指数加权平均? β 如何选择? 1. 什么是指数加权平均 指数加权平均(exponentially weighted averges),也叫指 ...

- 指数加权平均、动量梯度下降法、RMSprop、Adam优化算法

目录 1.指数加权平均(exponentially weighted averages) 这里有一年的温度数据. 如果想计算温度的趋势,也就是局部平均值(local average),或者说移动平均值 ...

- 优化算法之指数加权平均详解

本文的内容来自deeplearning.ai 一.什么是指数加权平均 指数加权平均(exponentially weighted averges)也叫指数加权移动平均,通过它可以来计算局部的平均值,来 ...

- 改善深层神经网络:超参数调整、正则化以及优化——2.3指数加权平均

指数加权平均:vt=βvt−1+(1−β)θtv_t=\beta v_{t-1}+(1-\beta)\theta_tvt=βvt−1+(1−β)θt: 当β=0.9\beta=0.9β=0.9时 ...

- Adam优化算法中的指数移动平均

机器学习经典算法(三)--指数加权平均 机器学习经典算法(三)–指数加权平均 指数加权平均(Exponentially Weighted Averages)是一些改进梯度下降法重要理论,如上篇博文梯度 ...

- 机器学习经典算法(三)--指数加权平均

机器学习经典算法(三)–指数加权平均 指数加权平均(Exponentially Weighted Averages)是一些改进梯度下降法重要理论,如上篇博文梯度下降法(2)提到的动量梯度下降法,RMS ...

- 改善深层神经网络:超参数调整、正则化以及优化——2.5 指数加权平均的偏差修正

当β=0.98\beta=0.98β=0.98时,其实预测曲线是图中的紫色线,在一开始的时候由于v0=0v_0=0v0=0,导致前面部分的值低于预期的实际值,为了解决这个问题,加入了偏差修正. vt ...

- 通俗解释指数加权平均

前言 在深度学习优化算法中,我们会涉及到指数加权平均这个概念,下面我将通过例子来一步一步引出这个概念. 平均数求法 比如我们现在有100天的温度值,要求这100天的平均温度值. 24,25,24,26 ...

- 吴恩达老师深度学习视频课笔记:优化算法

优化算法能够帮助你快速训练模型. mini-batch梯度下降法:把训练集分割(split)为小一点的子训练集,这些子集被叫做mini-batch. batch梯度下降法指的是:同时处 ...

最新文章

- python怎么安装包-怎么安装python包

- C02-程序设计基础提高班(C++)第7周上机任务-指针

- logstash通过kafka传输nginx日志(三)

- elasticsearch使用优化备忘

- strspn函数php,php strspn函数怎么用?

- 关于idea Tomcat部署的一个小坑

- 常用函数的连续傅里叶变换对

- 计算机网络章末总结,计算机网络 (前两章总结)

- ZOJ1457 || HDU1016 素数环

- 5G网络能力开放的“接头人“——NEF

- 网易云音乐安装完成以后点击图标打不开的解决办法

- 计算机中模拟和数字信号,模拟信号和数字信号的区别是什么

- 国内Linux笔记天花板,不接受反驳!

- AsciiDoc 的相关整理

- 下载安装及编写第一个C语言程序Visual Studio 2019

- 安卓手机主题软件_安卓手机直播软件:绝影Live

- 网络威胁情报与美国国防工业基地

- [NOI2005] 瑰丽华尔兹

- dedecmsmip_织梦MIP响应式企业通用模板

- MySql史上最全总结

热门文章

- 营销人、新媒体人、广告人必备神器:电脑录屏工具!

- ios-bug.html黑屏重启,iPhone大规模爆发黑屏无限重启bug!附解决方法

- 联想r9000p怎么在官方加装硬盘

- wepy的安装与卸载

- 如何一步一步的开一家公司?

- 《Python数据处理》9.1.2探索表函数笔记:print不输出期望值而是输出内存地址或者数据类型

- 豆瓣评分9.4!评价最高的Python书籍《流畅的Python》

- LLMs:《Orca: Progressive Learning from Complex Explanation Traces of GPT-4》翻译与解读

- 3DS MAX 从手贱调配置崩坏 到修复可用的漫漫长路

- 如何进入隔壁女生的。。。