机器学习基石HOW部分(3)

机器学习基石HOW部分(3)

标签:机器学习基石

第十一章

binary classification via (logistic) regression; multiclass via OVA/OVO decomposition

所有的回归算法,经过一些修改,就可以用来做分类。但是分类算法无论怎么改都不能做回归。

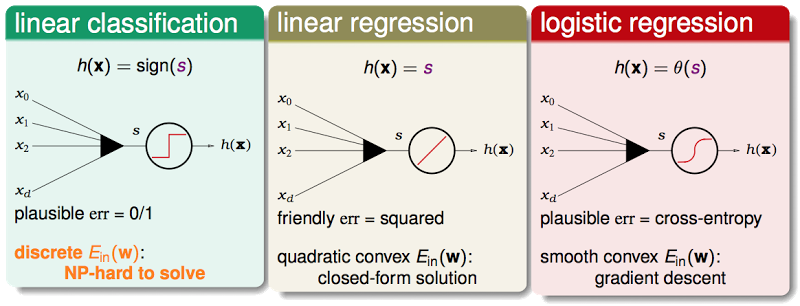

前面的章节介绍了三种线性模型,PLA、Linear Regression与Logistic Regression。之所以称他们是线性模型,是因为这三种分类模型的方程中,都含有一个相同的部分,该部分是各个特征的一个线性组合,也可以称这个部分叫做线性评分方程:

s=w^Tx

- Linear Classification模型:取s的符号作为结果输出,使用0/1 error作为误差衡量方式,但它的cost function,也就是 Ein(w) E_{in}(w)是一个离散的方程,并且该方程的最优化是一个NP-hard问题(简单说就是非常难解的问题)。

- Linear Regression模型:直接输出评分方程,使用平方误差square error作为误差衡量方式,好处是其 Ein(w) E_{in}(w)是一个凸二次曲线,非常方便求最优解(可通过矩阵运算一次得到结果)。

- Logistic Regression模型:输出的是评分方程经过sigmoid的结果,使用cross-entropy作为误差衡量方式,其 Ein(w) E_{in}(w)是一个凸函数,可以使用gradient descent的方式求最佳解。

Linear Regression和Logistic Regression的输出是一个实数,而不是一个Binary的值,他们能用来解分类问题吗?

当然可以,就像在最前面说的那样,回归模型可以用来做分类。只要定一个阈值,高于阈值的输出+1,低于阈值的输出-1就好。既然Linear Regression和Logistic Regression都可以用来解分类问题,并且在最优化上,他们都比Linear Classification简单许多,我们能否使用这两个模型取代Linear Classification呢?

好,下面看看可不可以代替。

拿Linear Regression或Logistic Regression来替代Linear Classification

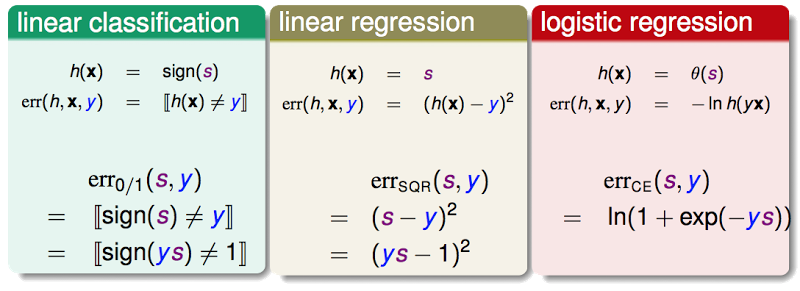

三个模型的区别在于误差的衡量,误差的衡量可以说是一个模型最重要的部分。不同的误差衡量可能会产生不同的g。

看看三种模型的误差衡量吧。

我们可以看到到三个模型的error function都有一个ys的部分,也叫做分类正确性分数 (classification correctness score)。其中s是模型对某个样本给出的分数,y是该样本的真实值。

既然叫做分类正确性分数,那就是正确性越高分数越高啦。

于是,我们将不择手段把分数提高。

当y=+1时,我们希望s越大越好,当y=−1时,我们希望s越小越好。

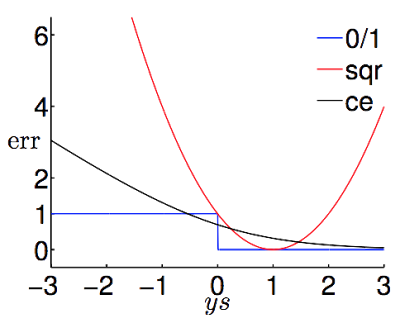

既然这三个error function都与ys有关,我们可以以ys为横坐标,err为纵坐标,把这三个函数画出来。

sqr (squre error)为Linear Regression的误差函数,ce (cross entropy)为Logistic Regression的误差函数。

errsqr err_{sqr}在ys较小的时候很大,但是,在ys较大的时候 errsqr err_{sqr}同样很大,这点不是很理想,因为我们希望ys大的时候cost要小,尽管如此,至少在 errsqr err_{sqr}小的时候, err0

机器学习基石HOW部分(3)相关推荐

- 太赞了!NumPy 手写所有主流 ML 模型,由普林斯顿博士后 David Bourgin打造的史上最强机器学习基石项目!...

关注上方"深度学习技术前沿",选择"星标公众号", 资源干货,第一时间送达! 用 NumPy 手写所有主流 ML 模型,普林斯顿博士后 David Bourgi ...

- NumPy 手写所有主流 ML 模型,由普林斯顿博士后 David Bourgin打造的史上最强机器学习基石项目!...

关注上方"深度学习技术前沿",选择"星标公众号", 资源干货,第一时间送达! 用 NumPy 手写所有主流 ML 模型,普林斯顿博士后 David Bourgi ...

- 台湾大学林轩田机器学习基石课程学习笔记1 -- The Learning Problem

红色石头的个人网站:redstonewill.com 最近在看NTU林轩田的<机器学习基石>课程,个人感觉讲的非常好.整个基石课程分成四个部分: When Can Machine Lear ...

- 台湾大学林轩田机器学习基石课程学习笔记15 -- Validation

红色石头的个人网站:redstonewill.com 上节课我们主要讲了为了避免overfitting,可以使用regularization方法来解决.在之前的EinEinE_{in}上加上一个reg ...

- 台湾大学林轩田机器学习基石课程学习笔记14 -- Regularization

红色石头的个人网站:redstonewill.com 上节课我们介绍了过拟合发生的原因:excessive power, stochastic/deterministic noise 和limited ...

- 台湾大学林轩田机器学习基石课程学习笔记13 -- Hazard of Overfitting

红色石头的个人网站:redstonewill.com 上节课我们主要介绍了非线性分类模型,通过非线性变换,将非线性模型映射到另一个空间,转换为线性模型,再来进行分类,分析了非线性变换可能会使计算复杂度 ...

- 台湾大学林轩田机器学习基石课程学习笔记12 -- Nonlinear Transformation

红色石头的个人网站:redstonewill.com 上一节课,我们介绍了分类问题的三种线性模型,可以用来解决binary classification和multiclass classificati ...

- 台湾大学林轩田机器学习基石课程学习笔记11 -- Linear Models for Classification

红色石头的个人网站:redstonewill.com 上一节课,我们介绍了Logistic Regression问题,建立cross-entropy error,并提出使用梯度下降算法gradient ...

- 台湾大学林轩田机器学习基石课程学习笔记10 -- Logistic Regression

红色石头的个人网站:redstonewill.com 上一节课,我们介绍了Linear Regression线性回归,以及用平方错误来寻找最佳的权重向量w,获得最好的线性预测.本节课将介绍Logist ...

- 台湾大学林轩田机器学习基石课程学习笔记8 -- Noise and Error

红色石头的个人网站:redstonewill.com 上一节课,我们主要介绍了VC Dimension的概念.如果Hypotheses set的VC Dimension是有限的,且有足够多N的资料,同 ...

最新文章

- 音视频通话:小议音频处理与压缩技术

- 三种sqrt函数实现

- 风控特征:时间滑窗统计特征体系

- Pandas学习笔记1(序列部分)

- Swagger Learing - Spring Boot 整合swagger

- python远程备份mysql_python3把服务器备份mysql数据库下载到本地

- script标签中defer和async的区别

- 检查vCenter Server上STS证书的过期日期(79248)(STS证书过期,导致 vCenter 报503无法登陆VC)

- linux基础命令-查看系统状态-free -m以及top命令详解

- Introduction to Computer Networking学习笔记(十三):传输层知识点学习总结

- 关于SRVINSTW与Kernel-Mode Driver Manager

- 基于微信小程序的竞赛管理系统

- 解决eclipse在安装时工作空间出错问题的有效方法

- 【论文阅读】2022年最新迁移学习综述笔注(Transferability in Deep Learning: A Survey)

- 新手指南:到国外域名注册商注册域名

- 2022年危险化学品生产单位安全生产管理人员操作证考试题库及答案

- R计算移动平均的方法

- 【跟Leon一起刷LeetCode】412. Fizz Buzz

- 在线客服系统源码 自适应手机移动端 支持多商家 带搭建教程

- service实现自动更换壁纸